ტექნოლოგიური მანიპულაციები Deepfake-ისა და ხელოვნური ინტელექტის გამოყენებით იყო თუ არა პუტინის ვიდეო ტექნოლოგიური მანიპულაცია?

By ელენე ლომსაძე •

Opinions expressed by Entrepreneur contributors are their own.

You're reading Entrepreneur Georgia, an international franchise of Entrepreneur Media.

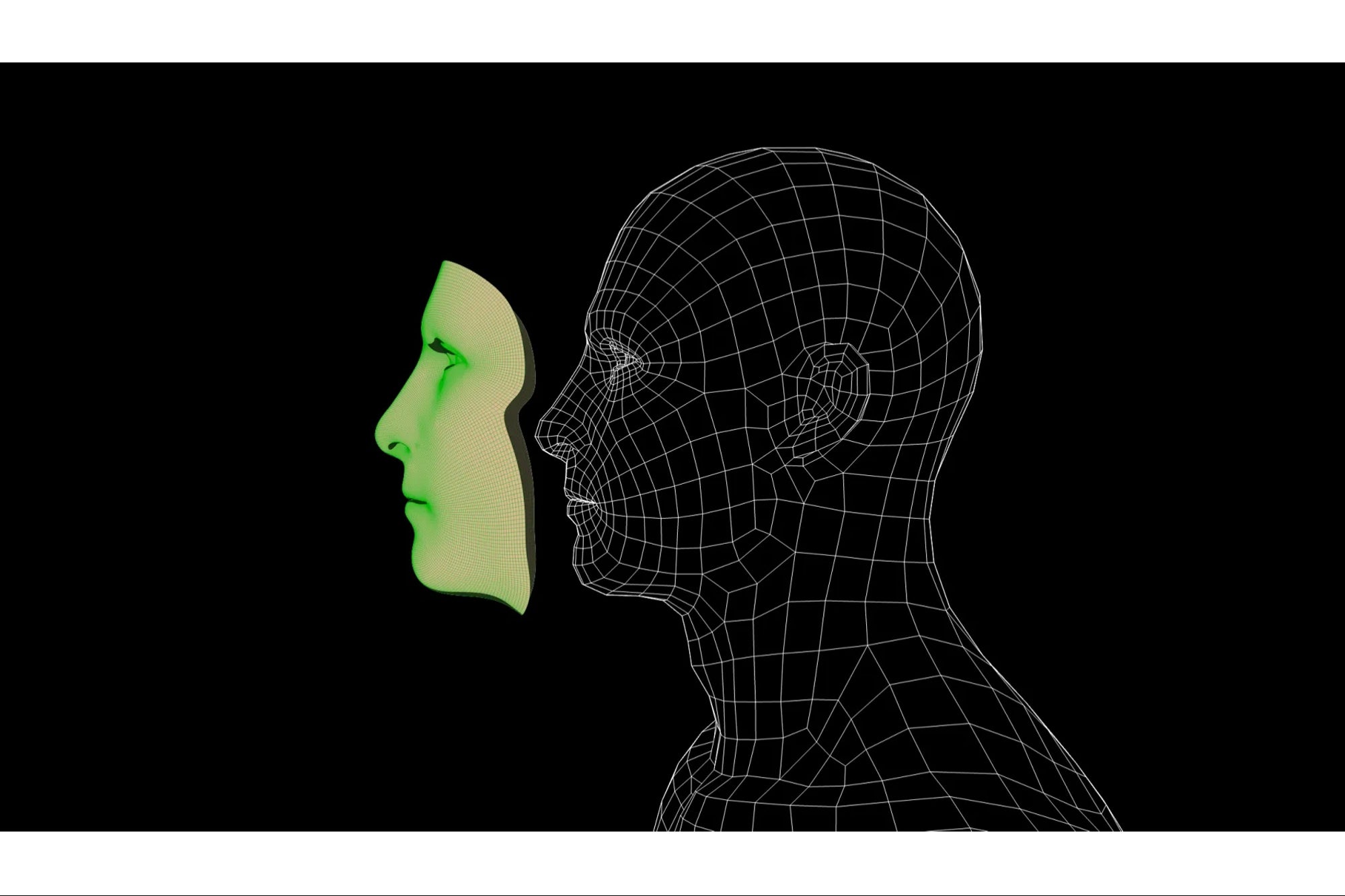

თანამედროვე ტექნოლოგიების ერთ-ერთი მნიშვნელოვანი მიღწევა ე.წ. Deepfake და ხელოვნური ინტელექტია. მიუხედავად იმისა, რომ ტექნოლოგიების დანიშნულება საყოველთაო კეთილდღეობის შექმნაა, რეალურად ინფორმაციის გამავრცელებელი წყაროები ხშირ შემთხვევაში ბოროტად იყენებენ საზოგადოების შესაცდენად და მათ გადაწყვეტილებაზე გავლენის მოსახდენად. ტექნოლოგიური მანიპულაციების გამოყენებას რუსეთ-უკრაინის მიმდინარე ომის პერიოდშიც ხშირად ვხვდებით და მას გარკვეული პოლიტიკური მიზნებისთვის იყენებენ. რა არის Deepfake და როგორ უნდა ვებრძოლოთ დეზინფორმაციას? − ამ საკითხებთან დაკავშირებით, Entrepreneur ატლანტიკური საბჭოს ციფრული გამოძიებების ლაბორატორიის მკვლევარ სოფო გელავას ესაუბრა.

რა არის Deepfake და რა მიზნით იყენებენ მას?

რა არის Deepfake და რა მიზნით იყენებენ მას?

Deepfake − ეს არის ტექნოლოგია, რომლის მეშვეობითაც შეგიძლია ააწყო ვიდეო ისე, რომ სასურველი ადამიანი ალაპარაკო რაზეც მოგესურვება, გააკეთებინო ის მოძრაობა, რომელიც გსურს. თავდაპირველი, ორიგინალი ადამიანი გარდაიქმნება ჩვენთვის სასურველ პიროვნებად ისე, რომ მისი მიმიკა და სიტყვები პროგრამულად არის დამუშავებული. დღესდღეობით, ძალიან ბევრი Deepfake-ია გასართობი მიზნით შექმნილი. მაგალითად, ხშირად აზიარებენ ჰოლივუდის მსახიობის ვიდეოებს. ამ კუთხით, Nicolas Cage-ზე ტრენდიც იყო შექმნილი. კიდევ ერთი გახმაურებული Deepfake, რომელიც გასართობი მიზნით შეიქმნა, არის Elon Musk-ის სიმღერა, რომლითაც საბჭოთა როკჯგუფის სიმღერა გააცოცხლეს.

დეზინფორმაცია, თავისი არსით, რა თქმა უნდა, ახალი მოვლენა არ არის − ის მე-20 საუკუნეშიც აქტიურად მუშაობდა, ცივი ომის პერიოდშიც, თუმცა დღეს, თანამედროვე ეპოქაში, უფრო მეტი გასაქანი და განვითარების გზა აქვს. გასულ წლებთან შედარებით ბევრად მეტი მეთოდი და ტექნოლოგია არსებობს იმისათვის, რომ რაც შეიძლება ფართო აუდიტორიას მისწვდეს დეზინფორმაცია და ამავდროულად, დამაჯერებელი ჩანდეს.

მიმდინარე ეპოქაში ტექსტის სახით ნაკლებად ხდება ინფორმაციის მიღება. ტრადიციული, ბეჭდური მედიიდან ინფორმაციის სწრაფად მიღება აღარ არის ისეთი რელევანტური. ცხადია, ის ისევ რჩება ინფორმაციის მთავარ წყაროდ, თუმცა კვლავ ამ ეპოქისა და ინფორმაციის სისწრაფის გათვალისწინებით, ონლაინსივრცე ყველაზე კარგი საშუალებაა მარტივი ინფორმაციული პროდუქტის შესაქმნელად. ამის გამოყენებით ადრესატი ინფორმაციას იღებს, აღიქვამს, ამუშავებს და ავრცელებს მარტივად და დამაჯერებლად. როდესაც დეზინფორმატორი თხზავს რაღაც ამბავს და ავრცელებს ყალბ ინფორმაციას, მას სჭირდება ვიზუალური მტკიცებულებები. იქნება ეს ფოტო თუ ვიდეომასალა, ამით გვაჩვენებს, რომ მის მიერ გავრცელებული სიახლე სინამდვილეს შეესაბამება. დამამტკიცებელი საბუთებისთვის მიმართავენ სხვადასხვა მანიპულაციას, მათ შორის: Deepfake-ისა და ხელოვნური ინტელექტის გამოყენებით.

რა სახის საფრთხეებთან ასოცირდება ტექნოლოგიური მანიპულაციები?

სწორედ ეს არის ყველაზე მთავარი საფრთხე − როგორ შეიძლება გამოიყენო ტექნოლოგია პოლიტიკური მიზნებისთვის და მოახდინო ემოციებით მანიპულაცია ადამიანებზე ისე, რომ შეაცვლევინო განწყობები და გადაწყვეტილებები. ამდაგვარი პროდუქტი შეიძლება იყოს ყალბი Deepfake-ვიდეო, რომელიც ვრცელდება წინასაარჩევნოდ მგრძნობიარე თემებზე და ეხება რომელიღაც კონკრეტული კანდიდატის წარმატებას ან დამარცხებას. არ არის აუცილებელი, Deepfake იყოს დისკრედიტაციისკენ მიმართული, შესაძლოა, ის გვევლინებოდეს პოპულარიზაციის იარაღადაც.

საერთაშორისო მასშტაბით არსებობს ისეთი შემთხვევები, როდესაც ფაბრიკაციულმა მასალებმა მნიშვნელოვანი გავლენა მოახდინა ფართო საზოგადოებაზე?

ერთ-ერთი მნიშვნელოვანი ქეისი ეხება გაბონს. როდესაც დიდი ხნის განმავლობაში გაბონის პრეზიდენტი არ ჩანდა მედიაში, საზოგადოებას შეექმნა განცდა, რომ ის გარდაიცვალა. ამ განწყობების ფონზე სამხედროებმა გადატრიალება გადაწყვიტეს. პრეზიდენტის გარდაცვალების ჭორების ფონზე გამოჩნდა ვიდეო, სადაც პრეზიდენტი მოსახლეობას მიმართავს. აქტორებმა დაიწყეს იმ აზრის პოპულარიზაცია, რომ ეს ვიდეო იყო Deepfake, ვინაიდან მისი მოძრაობა და მიმიკა არ იყო ბუნებრივი. სამხედროებს კიდევ უფრო მეტი შანსი გაუჩნდათ, მოეხდინათ გადატრიალება. ეს პროცესები საბოლოო ჯამში აღიკვეთა, თუმცა იმ აღქმამ, რომ ეს ვიდეო შესაძლოა ყოფილიყო ფაბრიკაცია, გამოიწვია დიდი პოლიტიკური ძვრები და მოვლენები. რაც შეეხება ვიდეოს, ის ნამდვილი იყო და არაბუნებრივი მიმიკა პრეზიდენტის ჯანმრთელობის პრობლემებით გახლდათ გამოწვეული.

მეორე მნიშვნელოვანი საკითხია ხელოვნური ინტელექტის მიერ გენერირებული ფოტოები. ეს არის ფოტომასალები იმ ადამიანებისა, რომლებიც სინამდვილეში არ არსებობენ. პროგრამა ამუშავებს ფოტოებს და იქმნება საკმაოდ რეალისტური სურათები, რომელიც ერთი შეხედვით ნამდვილს ჰგავს. როგორც ტენდენცია აჩვენებს, ყალბი ანგარიშები ძალიან ხშირად იყენებენ AI-ის მიერ გენერირებულ ფოტოებს, ვინაიდან, სურთ შექმნან სანდოობის ილუზია. ცხადია, იმ მომხმარებლების, რომლებსაც ცარიელი პროფილი აქვთ, არ გვჯერა. ერთი გზაა რუსული სოციალური ქსელებიდან ფოტოების მოპარვა და იდენტობის გაყალბება, ხოლო მეორე ტენდენციაა პროგრამულად დამუშავებული ფოტოების გამოყენება.

ამის ერთ-ერთ კარგი ილუსტრირება მოხდა 2021 წლის 17 იანვარს. როდესაც რუსი ოპოზიციონერი, ალექსეი ნავალნი რუსეთში ჩამოვიდა, თავის მხარდამჭერებს ფართომასშტაბიანი აქციებისკენ მოუწოდა. დემონსტრაცია რამდენიმე დღის შემდეგ უნდა გამართულიყო მოსკოვში, წითელ მოედანთან ახლოს. ზოგადად, ჩვენ რომ სოციალურ ქსელში ადგილი მოვძებნოთ, გეოლოკაციის მიხედვით აჩვენებს იქ მყოფი ადამიანის თეგებს. თუ საჯაროა მასალა, ყველასთვისაა ხელმისაწვდომი. შესაბამისად, თუ პარლამენტთან არის აქცია დაგეგმილი და Facebook-ზე ვეძებთ პარლამენტის გვერდს, უნდა გამოჩნდეს ფოტოები, რომელიც იმ მომენტშია გადაღებული იქ მყოფი ადამიანების მიერ. რეალურად, რა მოხდა რუსეთში? რუსეთში ნავალნის აქციამდე რამდენიმე დღით ადრე დაიწყო საინფორმაციო ველის დაბინძურება Instagram-ზე. ადამიანები, რომლებიც ეძებდნენ „წითელ მოედანს", მათ ინფორმაცია მისდიოდათ არა აქციების შესახებ, არამედ იღებდნენ პროგრამულად დამუშავებულ ფოტომასალებს. აღმოჩნდა, რომ ეს იყო გამიზნული საინფორმაციო ოპერაცია იმისათვის, რათა წითელი მოედნისა და იქ გამართული საპროტესტო აქციის შესახებ საზოგადოებას ინფორმაცია არ მიეღო. ბოტების ქსელმა აქტიურად იმუშავა და ფაქტობრივად, მიიტაცეს Instagram-ის ფიდი. ადამიანებს აღარ ჰქონდათ წვდომა იმ ინფორმაციაზე, რაც უნდა მიეღოთ. ამას მოჰყვა ბოტების მხრიდან ხელოვნურად გაზრდილი ინტერაქცია. აღსანიშნავია, რომ ის ანგარიშები, რომლებიც ყალბ ფოტოებს პოსტავდნენ Instagram-ზე, რამდენიმე დღით ადრე იყო შექმნილი და სხვა აქტივობა სოციალურ ქსელებში არცერთს არ ჰქონია.

დიდი გამოხმაურება გამოიწვია პუტინის ვიდეომ, რომელიც ინტერნეტში გავრცელდა. იყო თუ არა ის ტექნოლოგიური მანიპულაცია?

უახლესი ქეისი ვიდეომანიპულაციების დარგში იყო − პუტინის ვიდეო, რომელშიც ჩანდა, თითქოს სტიუარდესებს ხვდებოდა და მჭიდროდ ისხდნენ მაგიდასთან. სოციალურ ქსელებში გამოჩნდა მისი გაბათილება იმის თაობაზე, თუ რატომ არ იმყოფებოდა პუტინი რეალურად იქ. რთულია, დააკვალიფიცირო, ეს Deepfake იყო თუ უბრალოდ ვიდეომონტაჟი, მაგრამ სავარაუდოდ, პუტინი იყო სხვა ლოკაციაზე, მწვანე ფონზე ჩაწერილი და შემდეგ ჩასმული. Deepfake-ის შემთხვევაში მას სჭირდება წყარო და სახე, რომელსაც გარდაქმნი. მარტივად რომ ვთქვათ, თუ ეს ვიდეო იქნებოდა Deepfake, მაშინ მასში სხვა პირი უნდა ყოფილიყო, რომლის სახე შეიცვლებოდა პუტინის ვიზუალით. დეზინფორმატორებს გაეპარათ რამდენიმე ტექნიკური დეტალი, მაგალითად, პუტინს ხელი „შესდის" მიკროფონში, ასევე ჩაიდნები, რომელიც სტიუარდესების წინ იყო; ჩანდნენ ადამიანები, ხოლო პუტინის წინ არსებულ ჩაიდნებზე არ ჩანდა ამ ადამიანთა ანარეკლები. დიდი ალბათობით, პუტინის ვიდეო ბუნკერშია გადაღებული.

უახლესი ქეისი ვიდეომანიპულაციების დარგში იყო − პუტინის ვიდეო, რომელშიც ჩანდა, თითქოს სტიუარდესებს ხვდებოდა და მჭიდროდ ისხდნენ მაგიდასთან. სოციალურ ქსელებში გამოჩნდა მისი გაბათილება იმის თაობაზე, თუ რატომ არ იმყოფებოდა პუტინი რეალურად იქ. რთულია, დააკვალიფიცირო, ეს Deepfake იყო თუ უბრალოდ ვიდეომონტაჟი, მაგრამ სავარაუდოდ, პუტინი იყო სხვა ლოკაციაზე, მწვანე ფონზე ჩაწერილი და შემდეგ ჩასმული. Deepfake-ის შემთხვევაში მას სჭირდება წყარო და სახე, რომელსაც გარდაქმნი. მარტივად რომ ვთქვათ, თუ ეს ვიდეო იქნებოდა Deepfake, მაშინ მასში სხვა პირი უნდა ყოფილიყო, რომლის სახე შეიცვლებოდა პუტინის ვიზუალით. დეზინფორმატორებს გაეპარათ რამდენიმე ტექნიკური დეტალი, მაგალითად, პუტინს ხელი „შესდის" მიკროფონში, ასევე ჩაიდნები, რომელიც სტიუარდესების წინ იყო; ჩანდნენ ადამიანები, ხოლო პუტინის წინ არსებულ ჩაიდნებზე არ ჩანდა ამ ადამიანთა ანარეკლები. დიდი ალბათობით, პუტინის ვიდეო ბუნკერშია გადაღებული.

აქ მნიშვნელოვანია კიდევ ერთი დეტალი: გარდა იმისა, რომ ტექნიკური გადაცდომებია, სიმართლის დადგენა სხვა ხერხითაც შესაძლებელია. თუ მანამდე პუტინი პოლიტიკურ ლიდერებს დიდი დისტანციით ხვდებოდა, ამ ვიდეოში ძალიან ახლოს იჯდა. როდესაც დღეს უკრაინაზე ვსაუბრობთ, ემოციური ფონი საკმაოდ მძიმეა. შესაბამისად, ასეთ დროს ადამიანებით მანიპულირება უფრო მარტივი ხდება. გაყალბებული ვიდეოს გავრცელებას მოსახლეობა შეცდომაში შეჰყავს. სანამ პროფესიული წრეები დაადასტურებენ, რომ გავრცელებული ინფორმაცია ყალბია, საზოგადოებას რჩება განსხვავებული განწყობა და აღიქვამს მას დამაჯერებლად. დღესდღეობით, ტექნოლოგიური მანიპულაციების ბევრი შემთხვევა არ გვაქვს, თუმცა მთავარი არის ის, რომ ის ფლობს დიდ პოტენციალს, საზოგადოებაში დათესოს პანიკა და გავლენა მოახდინოს შემდგომ ქმედებებზე.